Snapchat anunció que sumará una marca de agua a las imágenes de la plataforma creadas por Inteligencia Artificial (IA) generativa y lo hará al exportarlas o guardarlas en el carrete de la cámara.

La compañía considera que los usuarios de la plataforma “deben estar informados sobre los tipos de tecnologías que utilizan”, para lo que la firma ya utiliza iconos, símbolos y etiquetas.

Estos últimos elementos aportan contexto e información cuando estos interactúan en conversaciones basadas en texto con el ‘chatbtot’ My AI, impulsado por ChatGPT.

UNA VERIFICACIÓN EXHAUSTIVA

También comentó que tiene “mucho cuidado” a la hora de examinar anuncios relacionados con la política a través de un proceso de revisión humana.

Dicho proceso de revisión incluye una verificación “exhaustiva” de cualquier uso engañoso del contenido o de la IA generativa.

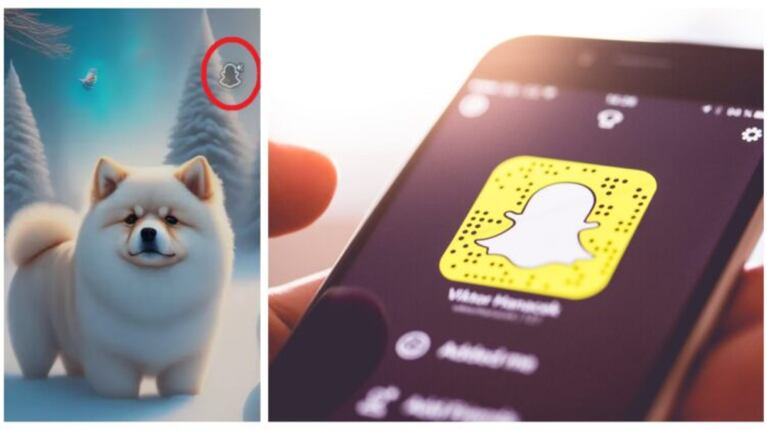

Los destinatarios de estas imágenes generadas con IA podrán visualizar el logotipo de Snapchat con una estrella en la parte superior derecha.

Dicha señal indica que para crear dicho contenido se ha utilizado alguna herramienta impulsada con esta tecnología.

SNAPCHAT RECOMIENDA NO EIMINAR LA MARCA DE AGUA

Snapchat ha actualizado su Centro de ayuda para recomendar a los usuarios no eliminar esta marca de agua, ya que supone una violación de los Términos de servicio de la plaraforma.

Asimismo, ha aconsejado no asumir que los resultados de la IA sean ciertos, debido a que es una tecnología “destinada a alterar o transformar una imagen”.

CUMPLIR CON LOS REQUISITOS DE PRIVACIDAD

Snapchat ha matizado que todas las funciones impulsadas por IA siempre se someten a una revisión estricta para garantizar que cumplan con sus principios de seguridad y privacidad.

Por este motivo, cuenta con el llamado equipo rojo de IA, que prueba la coherencia de los resultados de la IA e identifica fallas en los modelos para implementar soluciones de seguridad.

ELIMINACIÓN DE LOS MENSAJES POTENCIALMENTE PROBLEMÁTICOS

También destacó que cuenta con una serie de principios de gobernanza responsable y que creó un proceso de revisión de seguridad para detectar y eliminar mensajes potencialmente problemáticos.

Puntualmente, apuntó que estos serán quitados en las primeras etapas de desarrollo de las experiencias de AI Lens.

Asimismo, ha dicho que, teniendo en cuenta todo esto, está implementando pruebas adicionales para minimizar los resultados de IA potencialmente sesgados.

Fuente: EP.